目次

1. はじめに

2. サーバーの準備

3. FileMaker Server 2025 の設定

3.1. AI モデルサーバーを有効化する

3.2. Hugging Face トークンを登録する

3.3. AI モデルを選択する

3.4. API キーを設定する

4. スクリプトの作成

4.1. [モデルから応答を生成] の設定

4.2. [RAG 処理を実行] の設定

【ワンポイント】マシンスペックの影響とハードウェアの選定

5. おわりに

1. はじめに

このブログでは、Claris FileMaker でローカル LLM 環境を構築して AI を利用するための方法を解説します。

ChatGPT をはじめとする多くの AI はクラウドサービスとして提供されており、利用にあたってはさまざまな情報がクラウドに送信されることになりますが、会社のセキュリティポリシーで自社データの外部送信が制限されているので AI の導入を進められない、というケースは少なくありません。また、セキュリティの理由から閉域ネットワークを運用している企業などでは、そもそもこうしたサービスを利用することができません。

一方、FileMaker は、従来からオンプレミス環境での運用が可能であり、クラウド利用が制限または禁止されている企業や団体においても多数導入、利用されてきました。AI については、FileMaker Server 2025 で「AI モデルサーバー」が同梱されておりローカル LLM に対応し、オンプレミス環境で安全・安心にご利用いただけるようになっています。

では、具体的にどのような設定や対応が必要になるのか、順を追って見ていきましょう!

※ AI モデルのダウンロードの際のみインターネット接続が必要です。FileMaker Server の AI モデルサーバー上に AI モデルをダウンロードすることで、ローカルネットワークでの LLM 運用が可能になります。

2. サーバーの準備

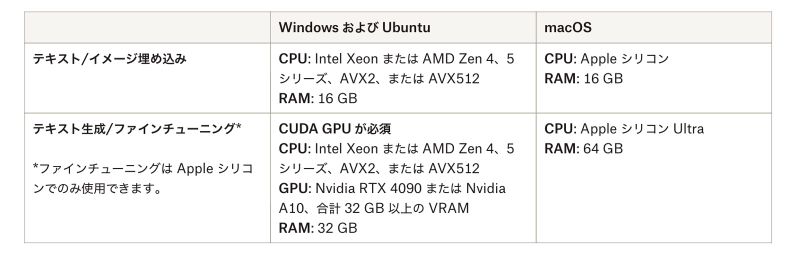

まず、ローカル LLM 環境を利用するための条件ですが、FileMaker Server 2025 で AI モデルサーバーを使用する場合の最小要件は下記のとおりです(最新情報は、「Claris FileMaker 2025 動作環境」の「サポートされるオペレーティングシステムおよびデバイス」および「AI モデルサーバーの必須ハードウェア:」から確認してください)。

ここで、「動作環境を満たすサーバーがすぐには用意できないので、まずは手持ちの機材を使ってテストで動かしてみよう」とした場合にどうなるか、という点について確認しておきましょう。結論としては、AI モデルのダウンロードはできても応答速度が極端に遅くなったり、ロード時にメモリ不足のエラーが表示されて実行できなかったり、そもそもダウンロードに進めない場合もあります。

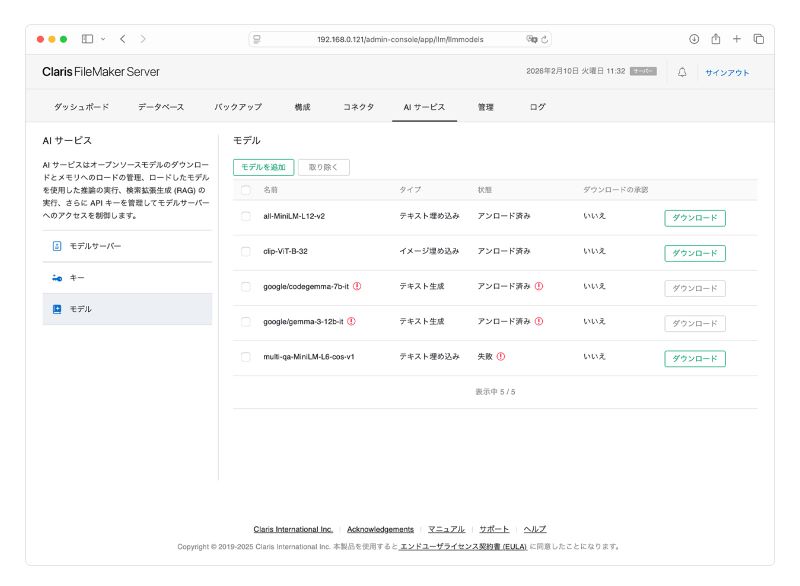

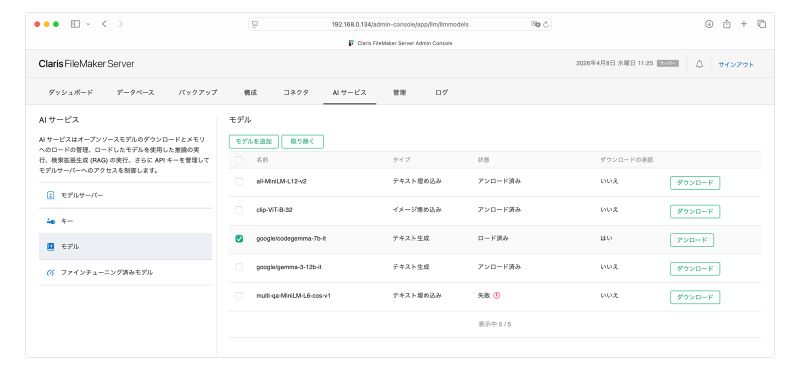

下図は、必須ハードウェアの要件を満たしていない Ubuntu Linux で構築した FileMaker Server の例ですが、ダウンロード前にエラーが発生しています。Google の AI モデル名の右に赤丸の「!」が付いており、「!」をポイントすると実行に必要な RAM が表示されます。この場合は、それぞれ以下の RAM が必要でした。

- google/codegemma-7b-it・・・16GB 以上

- google/gemma-3-12b-it・・・24GB 以上

メモリ不足によるダウンロード実行エラー

要件を満たすハードウェアを準備することは、ローカル LLM 環境を実現するための第一歩ですが、調達にあたってはさまざまな検討事項が生じるかと思います。Claris のナレッジベース「独自の AI モデルサーバーの運用」には、AI モデルサーバーの構築、運用にあたって必要となるスペックの情報が詳述されていますので、合わせてご参考ください。

3. FileMaker Server 2025 の設定

3.1. AI モデルサーバーを有効化する

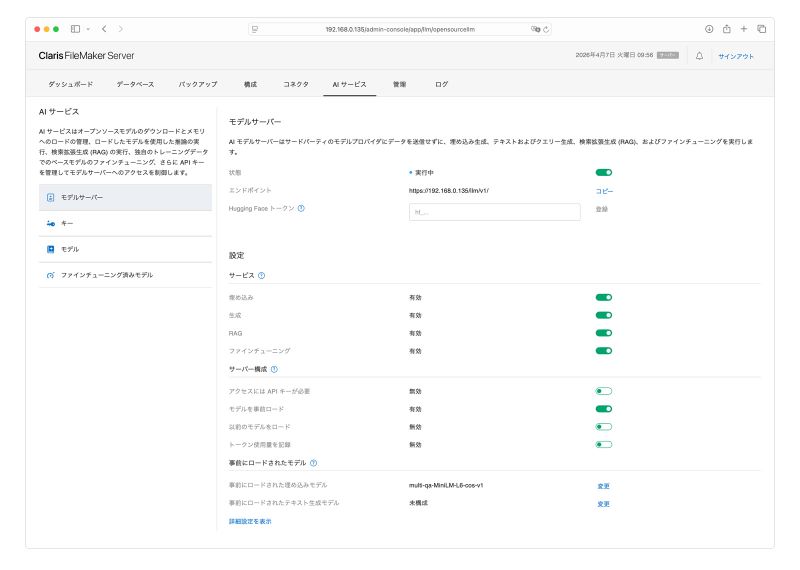

FileMaker Server 2025 のインストールが終わり準備ができたら、続いて、Admin Console の [AI サービス] タブから AI モデルサーバーを有効化します。基本的な手順は Claris FileMaker Server ヘルプに記載がありますが、以下、少し補足します。

AI モデルサーバーを有効にすると、Miniforge のダウンロードが促されます。Miniforge は、AI モデルサーバーがローカルネットワークで AI モデルを実行するために必要となる Python 実行環境です。指示に従って Miniforge のインストールファイルをダウンロードし、アップロードを行います。正常に処理が完了すると [状態] が「実行中」となります。環境によっては「実行中」になるまで数分程度かかりますので慌てずに待ちましょう。

AI モデルサーバーを有効化済み

AI モデルサーバーが「実行中」になったら、次は、Hugging Face トークンの登録です。

3.2. Hugging Face トークンの登録

FileMaker Server の AI モデルサーバーは、AI モデルの共有・活用を目的としたオープンソースプラットフォーム「Hugging Face」で提供されているモデルをダウンロードして使用します。一部のモデルではダウンロードの際に認証が実行されるため、事前に Hugging Face アクセストークンを AI モデルサーバーに登録しておく必要があります。本ブログでは、「FileMaker Server 2025 動作環境」に記載のある、以下のオープンモデルを取り上げていますが、いずれも Hugging Face アクセストークンが必要です。

このあとは、google/codegemma-7b-it を例に登録の手順を見ていきます。なお、Hugging Face のアカウントは作成済みであるものとします。

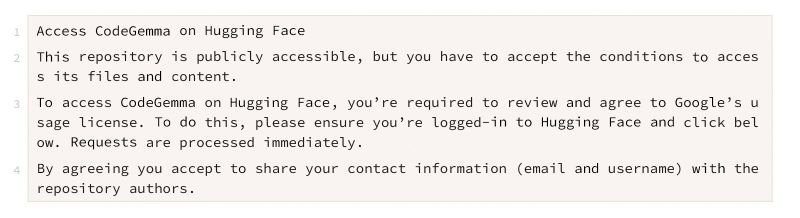

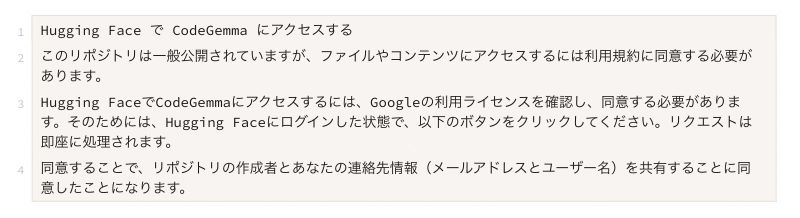

google/codegemma-7b-it のページにアクセスしたら、まず、以下の利用規約に同意します。

日本語に翻訳したものが以下となります。

規約への同意後、以下の手順で、アクセストークンを作成し、登録します。

- Hugging Face ログイン後、右上のボタンから [Access Tokens] に移動

- [Create new token] をクリックし、トークン作成画面に移動

- [Token type] は [Read] を選択

- [Token name] で管理しやすい名前を付けて [Create token]をクリック

- 発行されたトークンをコピーし、安全な場所に保存

- 保存したトークンを、Admin Console の [Hugging Face トークン] に登録

3.3. AI モデルを選択する

以上でダウンロードの準備が整いましたので、次は AI モデルを選択します。以下の図は、デフォルトで表示されている google/codegemma-7b-it を選択してダウンロードを実行した後の画面です。

操作はダウンロードボタンを押してモデルを追加するだけなのですが、AI モデルは容量が大きく、このモデルの場合は約 17GB あります。ダウンロードはすぐには完了しないため、「ロード済み」となるのを待ちましょう。

3.4. API キーを設定する

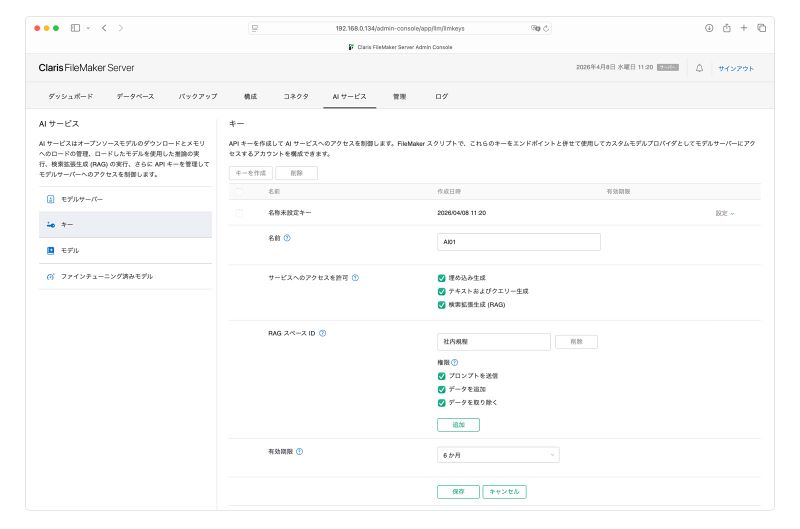

この手順は、ローカル LLM がクライアントから AI モデルサーバーにプロンプトを送信する際 API キーを利用する場合に必要になります。API キーはプログラムが使用するパスワードのようなもので、これを必要としないなら誰でも実行できることになります。初期テスト段階ではセキュリティが甘い状態も許容されますが、実運用ではデータの機密性なども考慮して API キーを利用するかどうかを決定する必要があります。今回は API キーを利用するという前提で説明を進めます。

まず [モデルサーバー] タブの [アクセスには API キーが必要] を有効に設定した後、[キー] タブに移動し、下図のように、[名前]、[サービスへのアクセスを許可]、[有効期限] の各項目を設定します。[サービスへのアクセスを許可] では全ての項目にチェックを入れます。なお、[RAG スペース ID] は、[サービスへのアクセスを許可] で [検索拡張生成 (RAG)] にチェックを入れた場合に表示されるオプションです。詳細は、本ブログシリーズの「社内文書の情報検索に活用できる RAG(1)設定編」を参照してください。

今回は、以下のように設定しています。

- [名前] :「AI01」

- [サービスへのアクセスを許可]:全てをチェック

- [RAG スペース ID]:「社内規程」を設定し、[権限] では全てをチェック

- [有効期限]:「6 か月」

以上でサーバーの設定が完了しました。次は、いよいよローカル LLM を実際に利用するためのスクリプトを確認していきます。

4. スクリプトの作成

ここからは、ローカル LLM を利用するためのスクリプトについて解説します。

サンプルファイルも用意していますので、こちらからダウンロードして試してみてください。

今回は、[モデルから応答を生成] スクリプトステップと [RAG 処理を実行] スクリプトステップを取り上げます。これらのスクリプトステップは、以前、下記のブログでクラウドサービスの AI を使ったサンプルを紹介していますので、そちらと比較しながら内容を確認します(まだご覧になっていないブログは、ぜひチェックしてください!)。

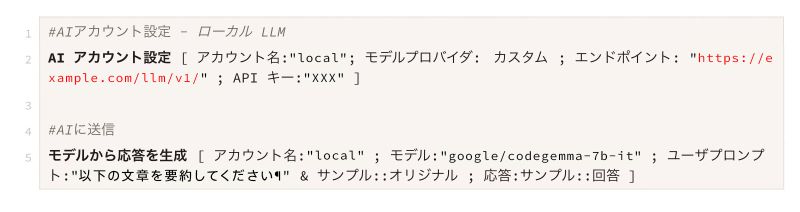

4.1. [モデルから応答を生成] の設定

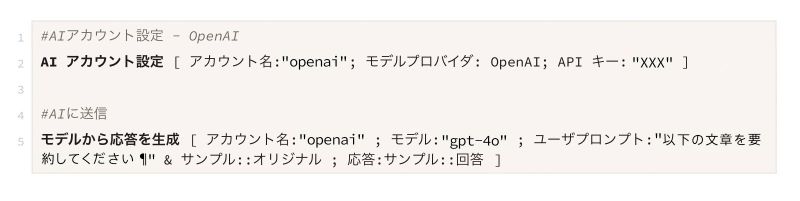

このスクリプトステップは、「ChatGPT を使うように AI に質問・指示」で取り上げました。その際に紹介したのは、下記のような文章の要約を行うサンプルスクリプトで、モデルは OpenAI の gpt-4o です。

今回、3.の手順で設定したローカル LLM 用の AI モデルサーバーで同様の処理を実行するには、スクリプトステップを下記のように設定します。なお、[エンドポイント] は、Admin Console の [AI サービス] タブの [モデルサーバー] から確認します。

ローカル LLM を使うといっても、クラウドサービスの AI のスクリプトと大きな違いはなく、変更する場合もとてもシンプルな手順で済むことがご理解いただけると思います。

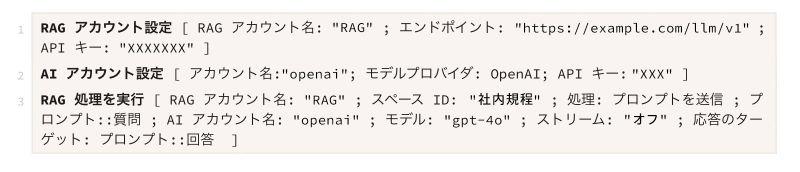

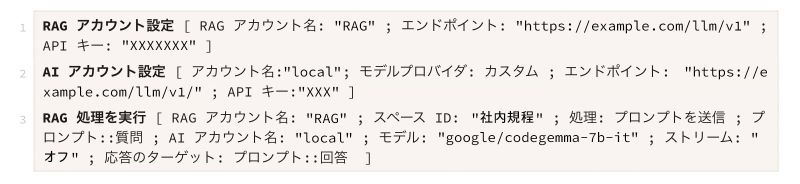

4.2. [RAG 処理を実行] の設定

こちらのスクリプトステップは、「社内文書の情報検索に活用できる RAG(2)利用編」で取り上げました。その際に紹介したのは、「社内規程」を対象に RAG 処理を実行するサンプルスクリプトです。テキストの埋め込みにはローカル LLM の paraphrase-multilingual-MiniLM-L12-v2 を使用しましたが、テキスト生成では、下記のように、OpenAI の gpt-4o を使用しています([AI アカウント設定] と [RAG 処理を実行] の内容を確認してください)。

今回、3.の手順で設定したローカルの AI モデルサーバーを使ってテキスト生成の処理を実行するには、[AI アカウント設定] と [RAG 処理を実行] の各スクリプトステップを下記のように設定します(4.1. 同様、[エンドポイント] は、Admin Console の [AI サービス] タブの [モデルサーバー] から確認します)。

[モデルから応答を生成] と同様に、クラウドでもローカルでもスクリプト自体に大きな違いはありません。変更する場合も、簡単な手順でローカル LLM でのテキスト生成処理が可能になります。

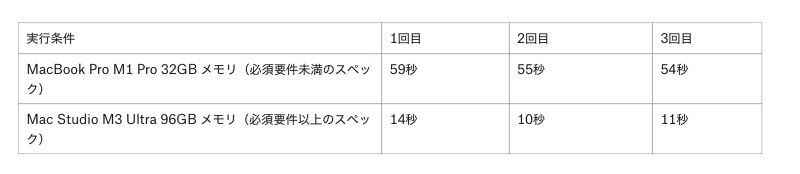

【ワンポイント】マシンスペックの影響とハードウェアの選定

Claris FileMaker でローカル LLM 環境を利用する場合、マシンスペックはパフォーマンスにどの程度の影響を与えるのでしょう。以下、簡易的な検証を行ってみた結果をご紹介します(厳密なテストではありません)。

下表は、4.1. で紹介した [モデルから応答を生成] スクリプトステップで、google/codegemma-7b-it を使い、文章を要約するスクリプトを 3回連続で実行した時にかかった時間を比較したものです。

このように、マシンスペックがパフォーマンスに大きく影響することがわかります。なお、参考までに、クラウドサービスである OpenAI gpt-4o を使って同じ処理を実行した場合は、上記いずれのスペックでも、すべて 10秒未満でした。ローカル LLM 環境の構築では、スペックが十分でない機材を使ってしまうと、思った以上に処理速度が落ちる可能性がありますのでお気をつけください。

ちなみに、これから AI 用に新たな環境の構築を検討している方にとって、上記検証で使用した Mac Studio は、ハードウェアの有力な選択肢の 1つです。FileMaker Server は、macOS、Windows Server、Ubuntu Linux で利用できますが、macOS はこの中で唯一のデスクトップ OS であり、GUI ベースで直感的に操作できるためサーバー構築に不慣れな方でも扱いやすいと言えます。Mac Studio は、その macOS が購入時点でセットアップされた状態で提供されるため、OS インストールやドライバ設定などに時間を取られることなく、初期設定後すぐに FileMaker Server のインストールや AI モデルサーバーの構築に取りかかれ、短時間で環境を立ち上げられます。必要なスペックを十分に満たせることに加え、なんといっても、導入から稼働までの手順が非常にシンプル、という点は大きいのではないでしょうか

5. おわりに

本ブログでは、FileMaker Server 2025 の AI モデルサーバーを使ったローカル LLM 環境の構築から、実際のスクリプトへの適用までを一通りご紹介しました。

ローカル LLM は、セキュリティポリシーや閉域ネットワーク等の組織上の制約でクラウド AI の導入を諦めていた方にとって、有力な選択肢となります。データが社外に一切出ないという安心感は、クラウドサービスでは得られない大きなメリットです。

また、すでに FileMaker で AI を利用中だが今後ローカル LLM を検討している、という方もいらっしゃるかと思います。ご覧いただいたように、使用するスクリプトステップはクラウドサービスの場合と基本的に同じで、変更の手順はモデルプロバイダとエンドポイントを書き換えるだけ、と非常にシンプルです。

ただし、テキスト生成をローカル LLM で快適に動かすためには、相応のハードウェアへの投資が必要です。まずは手元の機材でどの程度動作するのかを確認した後、本番運用に向けてサーバーを検討するという進め方がよいでしょう。新たにサーバーを用意する場合には、スペックと同時にセットアップの手軽さも考慮した選択をお勧めします。

FileMaker のオンプレミス運用の柔軟性と、ローカル LLM の安全性を組み合わせることで、AI 活用の可能性が大きく広がります。本ブログが、皆様の組織での導入を後押しする一助になれば幸いです。

なお、FileMaker Server 2025 をお持ちでない方は、45 日間使える無料体験版をダウンロードして試してみてください!