みなさんの日常生活や業務の中で ChatGPT、Gemini、Copilot、Apple Intelligence など、さまざまな AI を活用していることが多くあるのではないでしょうか。そんな AI を Claris FileMaker 2025 ではローコードツールらしく、簡単なスクリプトを用いて利用することが可能です。既成の AI 機能ではなく、みなさんの「こうしたい」「これが欲しい」に応える AI 機能を自在に作成して FileMaker のカスタム App に組み込み、AI の可能性を最大限に引き出すことができるのです。

FileMaker 2025 にはさまざまな AI 機能が追加されていますが、今回のブログでは、以下 7 つを厳選して、その概要をご紹介します。

- ChatGPT を使うように AI に質問・指示

- カスタム App のデータに基づいて回答

- 社内文書の情報検索に活用できる RAG(検索拡張生成)

- 安全・安心に AI を利用するためのローカル LLM 環境

- 蓄積されたデータを元に数値を予測

- 自然言語でレコードを検索

- モデルのファインチューニング

各機能の詳細は今後のブログで 1 つずつ解説していきますのでご期待ください。なお、記載の内容は Claris FileMaker Pro 22.0.1 をベースとしています。

1. ChatGPT を使うように AI に質問・指示

[モデルから応答を生成] スクリプトステップ

この機能では、AI に質問したり指示を出して回答を得ることができます。

- 質問への回答:一般的な質問や、指定した文章に基づく質問への回答

- 文章の要約・整理:指定した文章の要約、条件に基づいた整理

- 文章の生成:条件に応じた文章作成

- 文章から抽出:キーワードや条件に一致する内容の抽出(例)顧客対応履歴から質問と回答を抽出して FAQ を作成/報告書から事故につながり得るヒヤリハットを抽出

- 文章の分類:内容を条件に応じて分類(例)感情分析(ネガティブ、ポジティブ、ニュートラル)

- コード生成:条件に応じて HTML や JavaScript を生成

AI と聞いて最初に思い浮かぶのが ChatGPT という方は多いと思いますが、まさに ChatGPT とやり取りするように、かつ、FileMaker のデータベースにあるデータも利用しながら AI の力を活用できるのです。

非常に幅広い使い道が考えられる機能ですが、実際の業務での利用例として、OCR したテキストを項目ごとに分けて整理する、という使い方もあります。画像からテキストを取得する(OCR)機能としてはGetLiveText 関数が以前からありましたが OCR したテキストはすべて 1 つのテキストになるため、項目ごとの分割などその後の処理に手間がかかっていました。しかしながら、AI を使えば複数項目が混在したテキストでも簡単に項目ごとに分けることができます。

例えば、名刺を OCR するケースを考えてみましょう。通常、カスタム App では「氏名」「会社名」「メールアドレス」などのフィールドでデータを管理していると思います。このとき、GetLiveText 関数で OCR したテキストではこれらの項目がひとまとまりになってしまいますが、AI に対して「このテキストを氏名、会社名、メールアドレス……の項目に分けて」と指示すれば、AI 側で適宜判断しフィールドごとの値に分けてくれます。あとは [フィールドを名前で設定] スクリプトステップなどを利用して FileMaker のテーブルに値を保存することが可能となります。

ちなみに、FileMaker 2025 では GetTextFromPDF 関数という関数が追加されました。これにより、テキスト情報を持つ PDF であればそこに含まれるテキストを抜き出すことができます。例えば、請求書や納品書の PDF に対して上記のような方法で中身のデータを FileMaker のフィールドに保存するなど、さまざまな用途に活用できます。

また、スクリプトステップの [ツールの定義] オプションを使用すると、OpenAI の機能にある Function Calling のように、開発者があらかじめ定義したツール(外部関数)を LLM の回答生成のために利用できます。FileMaker では、カスタム関数をこのツールとして指定することで、より柔軟で、複雑な処理が可能になります。

この機能のサンプルは、動画「Claris FileMaker 2025 AI 新機能 [モデルから応答を生成]スクリプトステップ」をご覧ください。

2. カスタム App のデータに基づいて回答

[自然言語で SQL クエリーを実行] スクリプトステップ

この機能では、AI に対して指定したテーブルのデータに関する検索や集計を自然言語で指示し、その結果を文章で取得できます。内部的には SQL クエリーを利用しているためこの名称になっていますが、SQL の知識がなくても問題なく使えます。

例えば次のような、質問・指示が可能です。

- 「先月、販売数の多い商品トップ 10 を教えて」

- 「2025/4/1 から現在までの製品ごとの故障率の平均を計算して」

これらの例では Sum、Average、Count といった SQL の集計関数が利用されますが、裏側で自動的に実行されるため、カスタム App 側で集計用のフィールドをあらかじめ用意しておく必要もありません。

この機能は SQL ベースの集計機能も利用可能なことから、特に数値や数量などを伴う定量データとの親和性が高いことが特徴です。FileMaker には現場の業務に紐づいたさまざまなデータが蓄積されているかと思いますが、この機能を使うことで、そういった既存データをこれまで以上に柔軟かつ効率的に活用できるようになります。

この機能のサンプルは、動画「Claris FileMaker 2025 AI 新機能 [自然言語で SQL クエリーを実行] スクリプトステップ」をご覧ください。

3. 社内文書の情報検索に活用できる RAG(検索拡張生成)

[RAG アカウント設定] スクリプトステップ

[RAG 処理を実行] スクリプトステップ

企業には、社内規程や手順書、FAQ、マニュアル、製品資料など、多様な文書やまとまった情報が蓄積されています。こうした情報をナレッジデータベースに登録し、検索と生成 AI を組み合わせて、必要な情報を自然な文章として取得できる仕組みが RAG(検索拡張生成)です。

例えば、以下のような用途での利用が一般的です。

1. ナレッジ共有

- 社内の Q&A、議事録、手順書を横断的に検索して必要な情報を得る。

- 新人教育や引き継ぎ作業の効率化に有効。

2. 顧客対応支援

- コールセンターやチャットサポートでマニュアル・過去 FAQ から回答に必要な情報を得る。

- 情報の検索を効率化し、顧客へのレスポンス時間短縮につながる。

3. 製品・サービス情報検索

- 製品仕様書やトラブルシューティング手順を検索し、問題解決のための情報を得る。

- 営業担当者なら社内商品データベースをもとに提案資料作成に使える情報を収集する。

4. 法務・コンプライアンスチェック

- 規程や契約書の過去事例を検索し、関連する条文やガイドラインを確認する。

- チェック作業の抜け漏れ防止にもつながる。

5. 研究・開発支援

- 技術文書、研究報告、特許情報を検索しつつ必要な情報を得る。

- 大量文書の調査にかかる時間を削減できる。

FileMaker 2025 ではこの RAG の仕組みを手軽に利用するための機能が追加されました。具体的には、サーバー(Claris FileMaker Server 2025)とクライアント(Claris FileMaker Pro 2025)でそれぞれ以下のような機能が追加されています。

- FileMaker Server 2025 では、RAG のナレッジデータベースが追加され、そこにアクセスするためのキーの発行などを Admin Console から行えます。

- FileMaker Pro 2025(カスタム App)では、冒頭のスクリプトステップを利用して、ナレッジデータベースへのデータ登録や RAG を利用した質問を行うことができます。

RAG を個別に構築しようとすると、ナレッジベースの準備のほかデータのチャンキング、埋め込み処理、セマンティック検索と言った処理の実装など、大きな手間がかかりますし知識も必要です。FileMaker 2025 では、これらをとても手軽に実現できます。カスタム App に蓄積された既存データを RAG と組み合わせて活用したり、RAG を利用した処理を従来のワークフローの中に柔軟に組み込むことも可能です。「RAG を構築するぞ」と身構えることなく、GUI ベースのシンプルな手順で、現場で使われてきた FileMaker アプリに “AI で探す・理解する” という能力を追加して拡張できることが、FileMaker による RAG サポートの最大のメリットと言えるでしょう。

この機能のサンプルは、動画「Claris FileMaker 2025 AI 新機能 RAG(検索拡張生成)」をご覧ください。

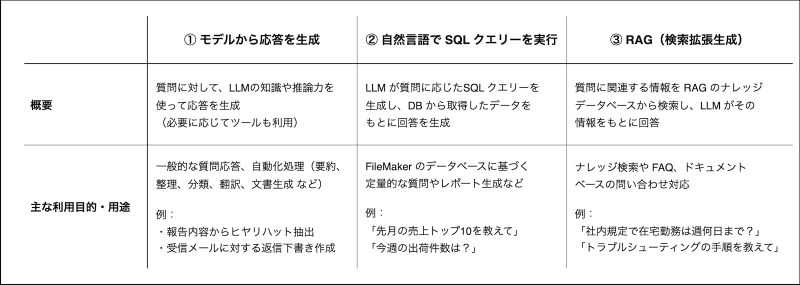

以上 3 つの機能は “AI との対話” を行うという意味では共通していますが、その仕組みや、目的、適した利用シーンには違いがあります。その違いについては以下を参考にしてください。

4. 安全・安心に AI を利用するためのローカル LLM 環境

ChatGPT をはじめとする多くの AI はクラウドサービスとして提供されており、利用にあたってはさまざまな情報をクラウドに送信する必要があります。外部のクラウドサービスに自社のデータを送信することに抵抗を感じる方は多く、会社のセキュリティポリシーで禁止されている、というケースも少なくありません。また、これらのサービスはインターネット接続が前提のため、大規模な医療機関の電子カルテネットワークや自治体のマイナンバー利用事務系、その他セキュリティの理由から閉域ネットワークを運用している企業などではそもそも利用することができません。

一方、FileMaker は従来からオンプレミス環境でも運用が可能であり、クラウド利用が制限、禁止されている企業や組織においても多数利用されています。FileMaker Server 2025 では、ローカルネットワーク内で LLM を運用するための「AI モデルサーバー」を提供することで、AI についても同様に、オンプレミス環境で安全・安心にご利用いただけるようになりました。

もちろん、そこで利用できるのは ChatGPT ではなく、Hugging Face を通じて提供されているオープンソースモデルです。一例を挙げると、Google 社が提供する「google/gemma-3-12b-it」です。このモデルを AI モデルサーバー上にダウンロードすることで、ローカル環境※での LLM 運用が可能になります。

※ モデルのダウンロードの際のみインターネット接続が必要です。

この機能のサンプルは、動画「Claris FileMaker 2025 AI 新機能 ローカル LLM」をご覧ください。

5. 蓄積されたデータを元に数値を予測

[回帰モデルを構成] スクリプトステップ

「回帰」という言葉は普段あまり耳にしないのでわかりづらいかもしれませんが、ここで言う回帰とは簡単に言うと「一連のデータを元に結果(数値)を予測するための方法」です。

例えば、工場の生産ラインではさまざまな機器や設備が稼働しており、定期的な点検により機器の状態を監視することはよくあります。ここで、回帰モデルを利用して過去の点検データや使用時間、温度、振動、修復履歴といった情報をもとに、劣化の進み具合や次の故障までの時間など、部品の寿命や交換時期などを予測することができます。

工場に限らず、売上や在庫数、作業時間、不動産価格など、“未来の数値を予測したい場面” で幅広く活用できます。これまで運用していたカスタム App に蓄積されたデータを二次的に活用するための有効な手法となるでしょう。

この機能のサンプルは、動画「Claris FileMaker 2025 AI 新機能 機械学習の回帰モデルで推論」をご覧ください。

6. 自然言語でレコードを検索

[自然言語で検索実行] スクリプトステップ

FileMaker では標準でレコード検索機能がありますが、それを自然な文章を使って実行するのがこの機能です。

例えば、

- 「名前が鈴木さんのデータを検索して」

- 「今月の売り上げを表示して」

のように、検索キーワードではなく “探したい情報” を入力をすることで検索ができます。

フィールドを明示的に指定せずに検索する、という意味では昔からある「クイック検索」と似ていると感じるかもしれません。どんなふうに違うのかというと、「クイック検索」はユーザによって入力された文字列を検索キーワードとして、その文字列が含まれるレコードを検索します。それに対して、この機能では、ユーザによって入力された文章をもとに AI が検索対象フィールドと検索条件を判断して検索を実行し、必要に応じてソートも行います。

従来の検索では、ユーザ側で、検索条件の作り方を知っていることや、レイアウトに配置されたフィールドを把握していることが必要でしたが、この機能を利用することで、異なる条件が複合的に絡んだ検索や、どのフィールドを対象に検索すべきか迷うようなケースでも自然な言葉で直感的にデータを探せるようになります。結果として、システム利用のハードルが下がると同時に、検索でできることの可能性が大きく広がります。

この機能のサンプルは、動画「Claris FileMaker 2025 AI 新機能 [自然言語で検索実行] スクリプトステップ」をご覧ください。

7. モデルのファインチューニング

[モデルをファインチューニング] スクリプトステップ

一般的に、LLM モデルは膨大な知識を事前学習しているほか、高い言語能力も持っていますが、特定の目的に合わせたデータをさらに追加学習させることで、その振る舞いや知識をカスタマイズする手法を「ファインチューニング」と呼びます。

例えば、FileMaker 2025 でサポートしている LLM モデルの 1 つである GPT-4o(OpenAI)は、多くのことを学習しており非常に優秀ですが、このモデルが学習している知識は 2024 年 6 月までに限られるため、それ以降の最新情報は含まれていません。また、利用用途によっては LLM の振る舞い(LLM が作成する文章のスタイル)を調整したいこともあるでしょう。このような場合に、ファインチューニングで「知識の補完」※ と「振る舞いの調整」を行い、利用目的に沿った回答が得られるようにすることができます。

※ 「知識の補完」については RAG も有効です。RAG は外部の文書や情報を参照することで最新情報へのアクセスを可能にしますが、ファインチューニングは知識をモデルそのものに組み込む、という点で異なります。

FileMaker 2025 では、このファインチューニングをスクリプトもしくは FileMaker Server の Admin Console から手軽に行うための機能が追加されました。FileMaker が持つデータを利用したファインチューニングも可能なので、蓄積されたデータを使ってモデルを “もっと賢くする” ことができるようになります。

この機能のサンプルは、動画「Claris FileMaker 2025 AI 新機能 モデルをファインチューニング」をご覧ください。

以上、FileMaker 2025 に追加された機能を 7 つご紹介しました。FileMaker 2025 にはこのほかにも数多くの AI 機能が追加されています。日々の業務効率化はもちろん、蓄積されたデータの活用や意思決定の質の向上など、AI によって得られる価値は飛躍的に広がります。ぜひ FileMaker 2025 の AI 機能を皆さんのカスタム App に取り入れ、新たな可能性を開きましょう!

FileMaker 2025 の AI に興味を持った方は、まずは 45 日間使える無料体験版をダウンロードして、試してみてください!